Au-delà des Poids Réels

La reparamétrisation PHM progressive compresse les modèles de langage multimodaux de 35 %, avec une inférence 48 % plus rapide tout en préservant la qualité — accepté à WACV 2026.

Un réseau neuronal basique qui relie les données de marché à des insights exploitables. L’information circule vers l’avant, couche par couche.

Désormais, le réseau se souvient. Les boucles permettent à l’information de persister et de capter les schémas qui se déploient sur des heures d’activité de marché.

LSTM étendu prolonge la mémoire sur plusieurs semaines. Il suit les niveaux structurels majeurs, les changements de régime et les cycles multi-semaines.

Fini le traitement séquentiel. Chaque donnée se connecte instantanément à toutes les autres — comme si 100 chercheurs travaillaient en parallèle.

LSTM capte le momentum. xLSTM suit les tendances structurelles. Les Transformers révèlent les corrélations cachées. Ensemble, ils font émerger des insights qu’aucun modèle seul ne pourrait découvrir.

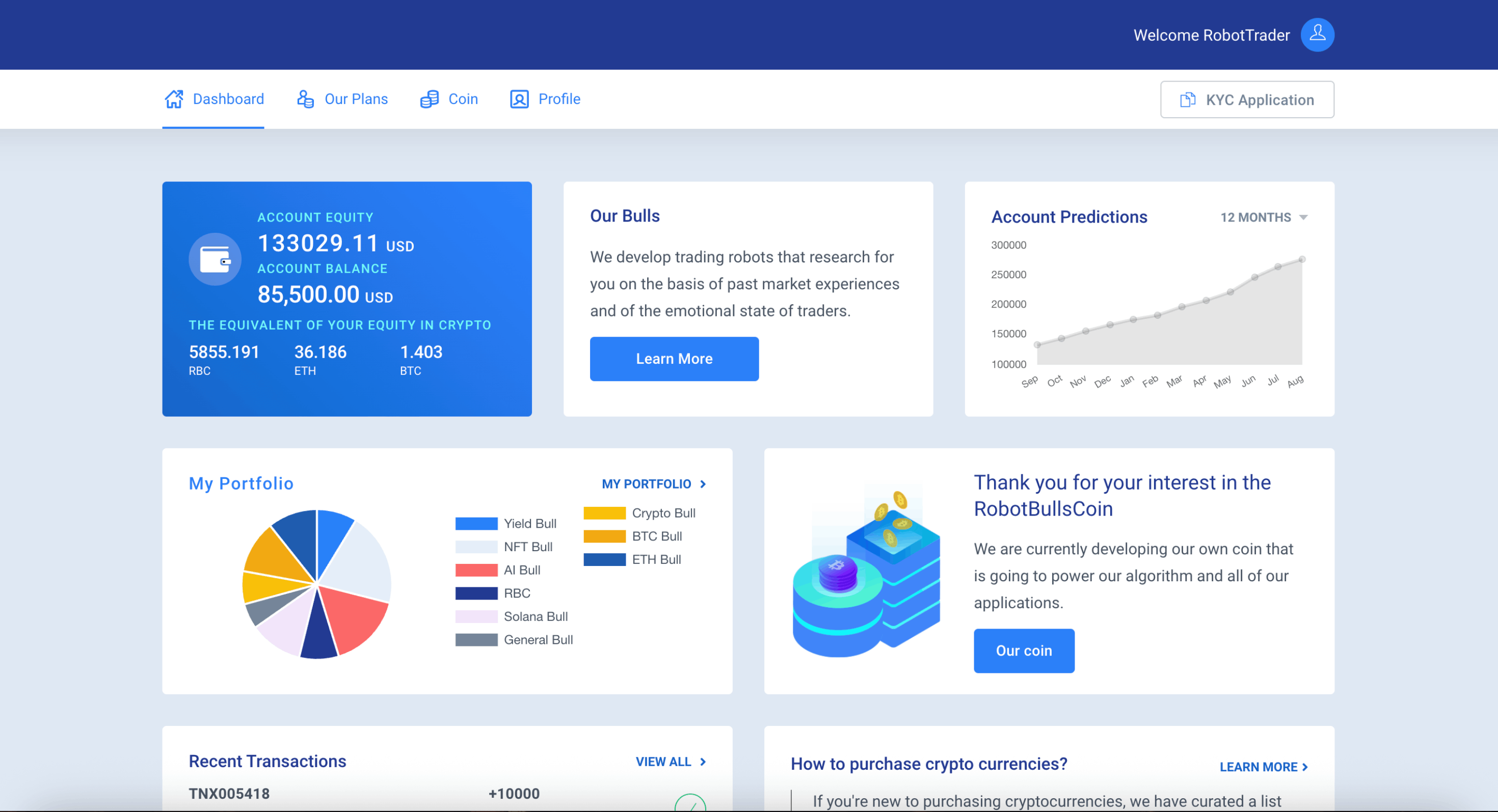

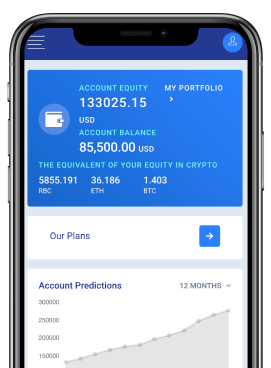

Les dernières mises à jour et avancées de RobotTrader

La reparamétrisation PHM progressive compresse les modèles de langage multimodaux de 35 %, avec une inférence 48 % plus rapide tout en préservant la qualité — accepté à WACV 2026.

Nouvelle méthode de fine-tuning bidirectionnel intégrant des rationales positifs et négatifs avec PEFT, permettant à des modèles 3B de surpasser des modèles 70B entraînés avec des labels seuls.

Explorer les recherchesDécomposition multi-échelle révolutionnaire combinant transformées en ondelettes et attention neuronale. Amélioration de 38,7 % de la précision des tendances.

Explorer les recherchesApproche révolutionnaire combinant sémantique en langage naturel et séries temporelles, avec 41,2 % de réduction des erreurs de prévision.

Explorer les recherches